- 您好,欢迎您访问成贯仪器官方网站!

高分辨率固态成像设备(主要是电荷耦合器件(CCD)和互补金属氧化物半导体(CMOS)图像传感器)的到来,预示了光学显微镜的新时代,该时代可能会超越胶片等传统图像记录技术,视频管和光电倍增管。许多原始设备和售后市场制造商都提供了专门为显微镜应用而设计的电荷耦合设备相机系统,而CMOS成像传感器现在已可用于少数显微镜。

两种技术都是在1970年代初和后期之间开发,但是CMOS传感器的性能令人无法接受,直到1990年代初,人们普遍忽略或认为它们只是出于好奇。到那时,CMOS设计的进步是生产出了像素尺寸更小,噪点更低,图像处理算法更强大以及成像阵列更大的芯片。CMOS传感器的主要优点之一是低功耗,主时钟和单电压电源,而CCD经常需要以不同的时钟速度提供5个或更多电源电压,而功耗却要高得多。CMOS和CCD芯片都利用光电技术通过相似的机制感应光当光子与结晶的硅相互作用以促进电子从价带进入导带时,就会发生这种效应。注意,术语“ CMOS”是指制造图像传感器的过程,而不是指特定的成像技术。

当可见光的宽波段入射到特殊掺杂的硅半导体材料上时,与入射在光电二极管表面的光子通量密度成比例地释放出可变数量的电子。实际上,产生的电子数量是入射到半导体的光的波长和强度的函数。电子被收集在势阱中,直到积分(照明)周期结束,然后将其转换为电压(CMOS处理器)或转移到计量寄存器(CCD传感器)。然后将测得的电压或电荷(转换为电压后)通过模数转换器,该转换器形成传感器成像的场景的数字电子表示。

光电二极管(通常称为像素)是数字图像传感器的关键元素。灵敏度由光电二极管可以累积的最大电荷,入射光子到电子的转换效率以及器件在受限区域内累积电荷而不会泄漏或溢出的能力所决定。这些因素通常由光电二极管的物理尺寸和孔径及其与阵列中相邻元素的空间和电子关系确定。另一个重要因素是电荷电压转换比,它决定了积分的电子电荷如何有效地转换为可以测量和处理的电压信号。光电二极管通常以正交网格的形式组织,其大小范围从128×128像素(16 K像素)到更常见的1280×1024(超过一百万像素)。几种最新的CMOS图像传感器,例如为高清电视(HDTV)包含数百万个像素,这些像素被组织成超过2000平方像素的超大型阵列。必须准确地检测和测量(读出)组成阵列的每一行和每一列的所有像素的信号,以便根据光电二极管电荷累积数据来组装图像。

在光学显微镜中,由物镜聚集的光通过投影透镜聚焦到传感器表面,该传感器表面包含相同光电二极管的二维阵列,称为图像元素或像素。因此,阵列尺寸和像素尺寸确定传感器的空间分辨率。CMOS和CCD集成电路本质上是单色(黑白)器件,仅响应光电二极管中累积的电子总数,而不响应光的颜色,从而导致其从硅基板中释放出来。通过使入射光通过一系列连续的红色,绿色和蓝色滤光片,或使用以马赛克图案沉积在像素阵列上方的微型透明聚合薄膜滤光片,可以检测颜色。

CMOS光电二极管的解剖结构

CMOS图像传感器比CCD图像传感器具有的主要优势是能够将许多处理和控制功能直接集成到传感器集成电路上,而这些功能超出了光子收集的主要任务。这些功能通常包括定时逻辑,曝光控制,模数转换,快门,白平衡,增益调整和初始图像处理算法。为了执行所有这些功能,CMOS集成电路架构更类似于随机存取存储单元,而不是简单的光电二极管阵列。最受欢迎的CMOS设计围绕有源像素传感器(APS)构建)技术,其中光电二极管和读出放大器都集成到每个像素中。这使得由光电二极管积累的电荷能够转换为像素内部的放大电压,然后按顺序的行和列传输到芯片的模拟信号处理部分。

因此,除了光电二极管之外,每个像素(或成像元件)还包含三合一晶体管,其将累积的电子电荷转换为可测量的电压,复位光电二极管,并将该电压传输到垂直列总线。所得的阵列是金属读出总线的有组织的棋盘格,在每个交叉点处都包含一个光电二极管和相关的信号准备电路。总线将定时信号施加到光电二极管,并将读出的信息返回到远离光电二极管阵列的模拟解码和处理电路。这种设计使阵列中每个像素的信号都可以通过简单的x,y寻址技术读取,而这是当前CCD技术无法实现的。

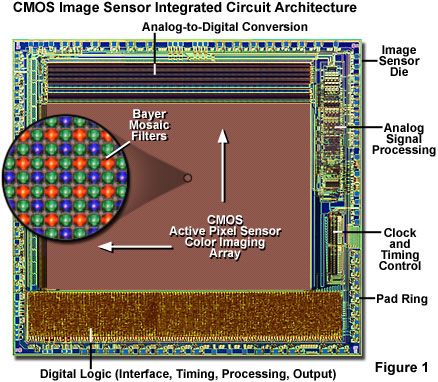

图1给出了一个典型的CMOS图像传感器的体系结构,该集成电路芯片包含一个640×480像素的有效图像区域。光电二极管阵列位于芯片的大红棕色中心区域,上面覆盖有序的红色,绿色和蓝色染料聚合物滤光片薄层,每个滤光片的大小适合于单个光电二极管(类似于用于彩色CCD的技术)。为了将入射的光子集中到光电二极管电子收集井中,已过滤的光电二极管也被装在称为微透镜或双凸透镜阵列的微型正弯月形透镜(参见图2、3和4)下方。图1中的插图显示了滤光镜和微透镜阵列的高倍放大视图。模拟信号处理电路还包括在图1所示的集成电路中,该电路收集并解释由光电二极管阵列产生的信号。然后将这些信号发送到位于芯片上部光电二极管阵列附近的模数转换电路(如图1所示)。CMOS图像传感器执行的其他任务包括用于逐步电荷产生,电压收集,传输和测量任务的时钟时序,以及图像处理和累积信号的输出。

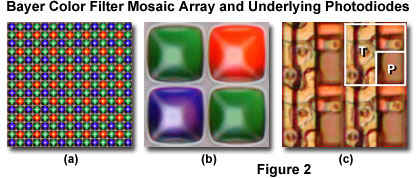

仔细观察光电二极管阵列,可以发现以柯达工程师Bryce E. Bayer的名字命名的马赛克图案排列的红色,绿色和蓝色滤光片的顺序图案。此滤色镜阵列(拜耳设计用于从来自光学透镜系统的宽带入射照明中捕获颜色信息。滤光片按四行排列(图2(a)和图2(b)),并按连续的行顺序排列,交替使用红色和绿色或蓝色和绿色滤光片(图2(a))。图2中显示的是由典型拜耳滤光片阵列的高分辨率光学显微镜和下面的光电二极管捕获的数字图像。图2(a)示出了交替的过滤器行的视图。每个红色滤镜被四个绿色和四个蓝色滤镜包围,而每个蓝色滤镜被四个红色和四个绿色滤镜包围。相反,每个绿色滤镜被两个红色,四个绿色和两个蓝色滤镜包围。基本重复单元的高倍放大图像如图2(b)所示,并包含一个红色,一个蓝色和两个绿色滤镜,使数组中绿色滤镜的总数等于红色和蓝色滤镜组合的数量。绿色滤光片的重点在于人的视觉响应,它在可见光谱的550纳米(绿色)波长范围内达到了最高灵敏度。

在图2(b)中还显示了微透镜阵列(也称为小透镜)的一小部分,这些微透镜通过光刻法沉积在拜耳滤镜的表面上并对齐,以使每个透镜都覆盖一个单独的滤镜。微型透镜元件的形状接近凸弯月透镜的形状,并用于将入射光直接聚焦到光电二极管的光敏区域中。在拜耳滤光片和微透镜阵列下面是光电二极管本身,它们在图2(c)中显示为四个完整的光电二极管组件或像素单元。图2(c)中的一个光电二极管用一个大白框(右上角)标识,该白框在较大的网格内还包含一个较小的矩形框。白框用字母P标识和T分别指像素的光子收集(光敏)和支撑晶体管区域。

从检查图2(c)中的光电二极管元件可以明显看出,大部分像素(在此示例中约为70%)区域专用于对晶体管相对不透明的支持晶体管(放大器,复位和行选择)。可见光光子,不能用于光子检测。剩余的30%(在图2(c)中标记为P的较小的白框)表示像素的感光部分。由于光电二极管的一小部分实际上能够吸收光子以产生电荷,因此填充系数或孔径图1、2和3所示的CMOS芯片和光电二极管的像素数仅占光电二极管阵列总表面积的30%。结果是灵敏度显着降低,信噪比相应降低,从而导致动态范围有限。填充因数比因设备而异,但通常,它们在CMOS传感器中占像素面积的30%至80%。

使减少的填充因子问题更为复杂的是光子吸收的波长相关性质,该术语适当地称为CMOS和CCD图像传感器的量子效率。三种主要机制可阻止光敏区域收集光子:吸收,反射和透射。如上所述,光电二极管面积的百分之七十以上可以被晶体管和堆叠或交错的金属总线屏蔽,它们是光学不透明的,吸收或反射与结构碰撞的大部分入射光子。这些堆叠的金属层还可能导致不良影响,例如渐晕,像素串扰,光散射和衍射。

入射光子的反射和透射是波长的函数,虽然大部分(在某些情况下)这些损耗可以很好地扩展到可见光谱区域,但大部分被反射的较短波长(小于400纳米)被反射。许多CMOS传感器在制造过程中都涂有黄色的聚酰亚胺涂层,在这些光子到达光电二极管区域之前,它吸收了很大一部分蓝色光谱。减少或最小化多晶硅和聚酰亚胺(或聚酰胺)层的使用是优化这些图像传感器的量子效率的主要考虑因素。

较短的波长在光敏区域的前几微米处被吸收,但是逐渐变长的波长在被完全吸收之前会钻到更大的深度。此外,最长的可见波长(超过650纳米)通常会穿过光敏区域而没有被捕获(或产生电子电荷),从而导致了另一个光子损失源。尽管微透镜阵列的应用有助于将入射的光子聚焦并引导到光敏区域中,并且可以使光电二极管的灵敏度提高一倍,但是这些微小的元件还显示出基于波长和入射角的选择性。

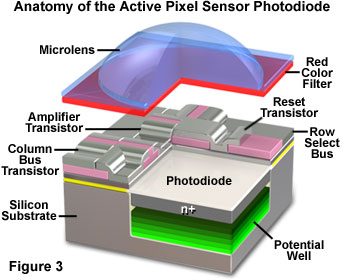

图3中显示的是典型CMOS有源传感器像素的三维剖视图,显示了感光区域(光电二极管),总线,微透镜,拜耳滤波器和三个支持晶体管。如上所述,CMOS图像传感器中的每个APS元件都包含一个放大器晶体管,该晶体管代表通常称为源极跟随器的输入设备。(源跟随器的负载在像素外部,并且在列中的所有像素共有)。源极跟随器是一个简单的放大器,它将光电二极管产生的电子(电荷)转换为输出到列总线的电压。此外,该像素还具有一个复位晶体管来控制积分或光子累积时间,以及一个将像素输出连接到列总线以进行读出的行选择晶体管。特定列中的所有像素都连接到读出放大器。

在操作中,图像捕获的第一步是初始化复位晶体管,以便从光敏区中排出电荷并反向偏置光电二极管。接下来,积分期开始,与像素的光电二极管区域相互作用的光产生电子,这些电子被存储在位于表面下方的硅势阱中(见图3)。当积分周期结束时,行选择晶体管导通,将所选像素中的放大器晶体管连接到其负载,以形成源极跟随器。因此,通过源极跟随器操作将光电二极管中的电子电荷转换为电压。所产生的电压出现在列总线上,并且可以由读出放大器检测到。

三像素APS设计的主要缺点之一是相对较高水平的伪影,称为固定图案噪点(FPN)。放大器晶体管增益和偏移的变化是制造过程中CMOS技术工艺波动的根本问题,会导致整个阵列的晶体管输出性能不匹配。结果是在捕获的图像中明显可见的噪点模式是恒定的,并且可以从一个图像复制到另一个图像。在大多数情况下,可以通过对位于阵列外围的模拟信号处理电路进行设计调整或通过对暗图像进行电子减法(平场校正)来显着降低或消除固定模式的噪点。

马赛克滤镜阵列和图像重建

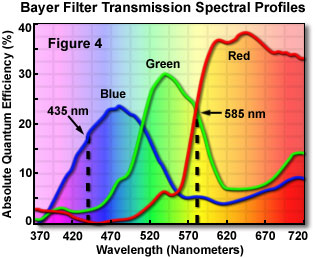

具有两倍于蓝色或红色的绿色滤光器的拜耳滤光器马赛克阵列的不平衡性质似乎也将出现关于单个像素的精确色彩再现的问题。拜耳滤光片的构造中使用的常见染料的典型透射光谱图如图4所示。红色滤光片的量子效率显着大于绿色和蓝色滤光片的量子效率,绿色和蓝色滤光片的整体效率彼此接近。请注意,滤镜之间的光谱重叠程度相对较高,尤其是在520至620纳米(绿色,黄色和橙色)区域。

关于将像素划分为拜耳滤光器图案的基本元素的光电二极管阵列的颜色再现和空间分辨率的确切性质,经常会产生疑问。像素尺寸为640×480像素的光电二极管阵列总共包含307,200像素,产生76,800拜耳四重奏。这是否意味着实际有用的图像空间分辨率降低到320×240像素?幸运的是,空间分辨率主要由彩色图像的亮度分量而不是色度(彩色)分量决定。发生这种情况是因为人脑可以将相当粗略的颜色信息添加到精细的空间信息中,并且几乎无缝地将两者整合在一起。此外,拜耳滤光片具有较宽的波长传输带(参见图4),并具有较大的重叠区域,

例如,假设有一个物体将大量的黄光(以585纳米为中心)反射到CMOS数码相机的镜头系统中。通过检查图4中的Bayer滤光片透射光谱,很明显,红色和绿色滤光片在该波长范围内透射相同量的光。另外,蓝色滤光片还透射大约20%的波长穿过其他滤光片。因此,每个四重奏中的四个Bayer滤镜中有三个通过了相等数量的黄光,而第四个(蓝)滤镜也透射了其中的一些光。相比之下,较低波长的蓝光(435纳米;见图4)仅以任何显着程度通过蓝色滤光片,

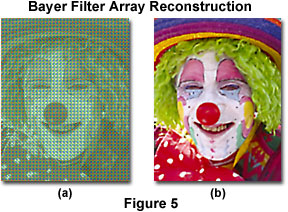

从由拜耳图案的彩色滤光片覆盖的CMOS光电二极管阵列获得原始图像后,必须通过插值方法将其转换为标准的红色,绿色和蓝色(RGB)格式。为了产生准确表示由电子传感器成像的场景的图像,此重要步骤是必需的。可以使用多种复杂且完善的图像处理算法(在图像捕获后直接在集成电路上)执行此任务,包括最近的邻居,线性,三次和三次样条技术。为了确定阵列中每个像素的正确颜色,算法对选定的相邻像素的颜色值进行平均,并对阵列中每个像素的颜色(色度)和强度(发光度)进行估算。图5(a)中显示的是通过插值重建之前的原始拜耳图案图像,图5(b)中显示的是经过线性插值算法的相关调整后的处理结果。

作为颜色插值功能的示例,请考虑嵌套在Bayer滤镜阵列中心区域的绿色像素之一。该像素被两个蓝色,两个红色和四个绿色像素包围,它们是其最接近的邻居。插值算法通过检查相邻红色和蓝色像素的色度和亮度值来生成绿色像素的红色和蓝色值的估计值。对阵列中的每个像素重复相同的过程。如果图像颜色在大量像素上缓慢变化,但是在出现较大颜色和/或强度过渡的边缘和边界区域,图像颜色也会缓慢变化,但也会遭受伪影(例如混叠)的影响,因此该技术会产生出色的效果。

为了提高量子效率和光谱响应,一些CMOS设计人员转向使用基于主减色的滤色器阵列:青色,黄色和品红色(CMY),而不是标准的加成原色红色,绿色和蓝色(RGB)。使用CMY滤光片阵列的优点之一是灵敏度提高,从而改善了通过滤光片的光透射率,并增强了信号强度。发生这种情况是因为与相应的添加剂滤光片相比,减色滤光片染料在可见光区域的光波吸收降低。与红色,绿色和蓝色滤光片(两层或更多层的复合材料会产生附加吸收)相反,CMY滤光片应用于具有优异透光特性的单层中。CMY滤镜的缺点是将从传感器收集的CMY数据转换为RGB值所需的更复杂的色彩校正矩阵,以便在计算机监视器上打印或显示图像。

噪点的来源和补救措施

CMOS图像传感器的一个主要问题是,在检查由这些设备产生的图像时,很容易发现明显的高噪点。传感器技术的进步已使信号处理电路与图像阵列紧密集成在一起,从而大大抑制了许多噪点源并大大提高了CMOS性能。但是,其他类型的噪点通常困扰设计师和最终用户。如上所述,现代CMOS采集后信号处理技术实际上已消除了固定模式噪点,但是其他形式(例如光子散粒噪点,暗电流,复位噪点和热噪点)却不那么容易处理。

在通过复位晶体管对光电二极管进行初始化或复位的过程中,会产生称为kTC(或复位)噪点的大噪点分量,如果不增强电路设计就很难将其消除。缩写k是玻尔兹曼常数,T是工作温度,C是出现在放大晶体管输入节点的总电容,由光电二极管电容和放大晶体管输入电容之和组成。重置噪点会严重限制图像传感器的信噪比。复位和另一个噪点源,通常称为放大器或1 / f低频噪点可以通过称为相关双采样(CDS)的技术进行控制,该技术必须通过向每个像素添加第四个“测量”(或传输)晶体管来实现。双采样算法通过单独测量复位或放大器噪点,然后减去组合的图像信号加上复位噪点来起作用。

光子散粒噪点在捕获的图像中很容易以随机模式出现,这是由于照明量的统计波动导致输出信号随时间变化而出现的。阵列中的每个光电二极管产生的光子散粒噪点略有不同,这在极端情况下会严重影响CMOS图像传感器的性能。对于比传感器的固有本底噪点大得多的信号,这种类型的噪点是主要的噪点源,并且出现在每个图像传感器(包括CCD)中。暗电流是由伪影产生的,这些伪影在没有照明的情况下会产生信号电荷(电子),并且在像素之间会表现出很大程度的波动,这在很大程度上取决于工作条件。这种类型的噪点对温度敏感,

几乎不可能消除暗电流,但可以通过在CMOS传感器制造过程中利用固定光电二极管技术来减少暗电流。为了产生钉扎的光电二极管像素,将P型硅的浅层施加到典型的N阱光敏区域的表面上,以产生改变像素的可见光谱响应的双结三明治。对表面结进行了优化,以响应较低的波长(蓝色),而深度较深的结对较长的波长(红色和红外)更敏感。结果,收集在势阱中的电子被限制在N附近远离表面的区域,导致暗电流及其相关噪点元素的减少。在实践中,可能很难构造一个固定的光电二极管像素,该像素在CMOS传感器工作的低压环境下会产生完全复位。如果没有达到完全的复位条件,则滞后会被引入到阵列中,并相应增加复位晶体管的噪点。固定光电二极管技术的其他好处是,由于增强了对P硅层界面附近的短波可见光辐射的捕获,因此改善了蓝光响应。

像素的感光区域之间纠缠的晶体管,电容器和总线负责在CMOS图像传感器中产生热噪点。可以通过微调成像器带宽,增加输出电流或冷却摄像头系统来减少此类噪点。在许多情况下,可以通过限制每个晶体管放大器的带宽来利用CMOS像素读出序列来减少热噪点。向低成本CMOS图像传感器中添加复杂且昂贵的Peltier或类似的冷却设备是不切实际的,因此通常不采用这些设备来降低噪点。

CMOS像素架构

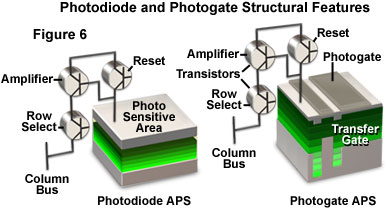

有在现代CMOS图像传感器利用了两个基本光敏像素元件架构:光电二极管和photogates(参见图6)。通常,光电二极管设计对可见光更敏感,尤其是在光谱的短波长(蓝色)区域。光电门器件通常具有较大的像素面积,但比光电二极管具有更低的填充系数和更差的蓝光响应(以及一般的量子效率)。但是,光电门通常会达到更高的电荷电压转换增益水平,并且可以轻松地用于执行相关的两次采样以实现帧差异。

光电门有源像素传感器利用CCD技术的多个方面来减少噪点并提高用CMOS图像传感器捕获的图像的质量。积分期间在光电门下方积累的电荷被定位到由访问晶体管很好控制的电位。在读出期间,支持像素电路执行电荷(作为电压)到输出总线的两阶段转移。第一步是通过放大器晶体管将累积的电荷转换为可测量的电压而发生的。接下来,传输门被脉冲化以启动电荷从光敏区域到输出晶体管的传输,然后被传递到列总线。这种传输技术提供了两个信号采样机会,可以通过有效的设计来利用它们来改善降噪效果。像素输出首先在光电二极管复位后采样,然后在积分信号电荷后再次采样。通过从第二个信号中减去第一个信号以消除低频复位噪点,光电门有源像素架构可以执行相关的双采样。

与光电二极管传感器相比,光电门设计的主要优点是在低光照条件下降低了噪点特性。基于光电二极管的CMOS传感器可用于中等性能的消费类应用,这些应用不需要具有低噪点,出色的动态范围和高度分辨的色彩特性的高精度图像。两种设备均利用经济的电源要求,这些要求可通过电池,计算机接口(USB和FireWire)的低压电源或其他直流电源来满足。通常,CMOS处理器的电压要求范围为3.3伏至5.0伏,但是较新的设计正在迁移至降低一半的值。

CMOS图像传感器操作顺序

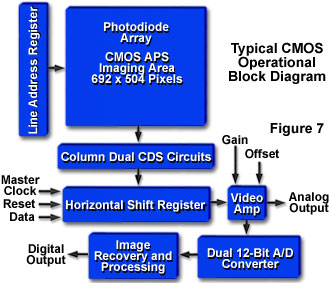

在大多数CMOS光电二极管阵列设计中,有源像素区域被以8至12行和列排列的光屏蔽像素区域包围,这些像素用于黑电平补偿。拜耳(或CMY)滤波器阵列从第一个非屏蔽行和列中的左上像素开始。当每个积分周期开始时,板上定时和控制电路将重置同一行中的所有像素,一次一行,从行地址寄存器分类的第一行到最后一行遍历(参见图1)。 7)。对于具有模拟输出的传感器设备,积分完成后,相同的控制电路会将每个像素的积分值传输到相关的双采样电路(CDS图7中的模块),然后再到水平移位寄存器。移位寄存器加载后,像素信息将被串行移位(一次一个像素)到模拟视频放大器。该放大器的增益由硬件或软件(在某些情况下是两者的组合)控制。相比之下,具有数字读出功能的CMOS图像传感器对每一列都使用模数转换器,并且对一行中的每个像素并行进行转换。然后采用宽度等于完成转换的位数的数字总线来输出数据。在这种情况下,仅数字值“串行”移位。白平衡算法通常在此阶段应用于像素。

在视频放大器中设置了增益和偏移值(图7中标记为Video Amp)之后,像素信息随后被传递到模数转换器,在此它被转换为二进制的线性数字阵列。随后,对数字像素数据进行进一步处理,以消除出现在“坏”像素中的缺陷,并在将其成帧并呈现在数字输出端口上之前补偿黑电平。黑色电平补偿算法(通常称为帧率钳位)从数字视频输出中减去阵列周围黑色像素的平均信号电平,以补偿有源像素阵列中与温度和时间相关的暗噪点电平。

该序列的下一步是图像恢复(参见图7),以及应用必要的基本算法来准备最终图像以进行显示编码。对像素执行最近邻居插值,然后使用抗锯齿算法对其进行滤波并缩放。恢复引擎中的其他图像处理步骤通常包括反渐晕,空间失真校正,黑白平衡,平滑,锐化,颜色平衡,光圈校正和伽玛调整。在某些情况下,CMOS图像传感器配备有辅助电路,这些辅助电路可实现片上功能,例如抗抖动(图像稳定)和图像压缩。图像经过充分处理后,将被发送到数字信号处理器以缓冲到输出端口。

因为CMOS图像传感器能够访问整个光电二极管阵列中的各个像素数据,所以它们可用于选择性地读取和处理为特定图像捕获的像素的选定部分。这种技术称为开窗(或感兴趣的窗口读数),并极大地扩展了这些传感器的图像处理能力。窗口通过定时和控制电路直接在芯片上进行控制,从而可以以一对一的像素分辨率访问和显示阵列有效区域内任何位置的任何尺寸的窗口。当需要对图像的一个子区域中的对象进行时间运动跟踪时,此功能可能非常有用。它也可以用于对选定部分或整个图像进行电子平移,缩放,加速读出和倾斜操作的片上控制。

大多数高端CMOS传感器具有几种读出模式(类似于CCD传感器中采用的读出模式),以提高软件接口编程和快门的多功能性。 渐进式扫描读出模式使光电二极管阵列中每一行中的每个像素都可以从左上角开始一直到右下角连续访问(一次一个像素)。另一种流行的读出模式被称为交错,并且通过在两个连续场读取的像素数据进行操作,一个奇数场,随后一个偶数领域。这些字段从阵列的顶部到底部以行的形式交替出现,并且在读取下一组之前,顺序记录一组的每一行。例如,在具有40个像素行的传感器中,首先读取到第39行的第一,第三,第五等,然后是第二,第四,第六,直到第40行。

CMOS图像传感器中的电子快门需要在每个像素上添加一个或多个晶体管,考虑到大多数设备中已经受到损害的填充因子,这是一种不切实际的方法。对于大多数区域扫描图像传感器来说就是这种情况。然而,已经开发了具有将快门晶体管放置在像素有源区域附近的线扫描传感器,以减小填充因子负载。许多设计人员已经实现了一种非均匀滚动快门解决方案,该解决方案利用最少的像素内晶体管以不同的时间间隔对阵列中的连续行进行曝光。尽管滚动快门机制对于静止图像运作良好,但它们会产生运动模糊,从而导致高帧速率下的图像失真。为了解决这个问题,工程师们精心制作统一的同步快门设计可一次曝光整个阵列。由于此技术在每个像素处都需要额外的晶体管,因此除非同时实现较大的像素,否则填充因子比例会有所折衷。

CMOS图像传感器的动态范围由光电二极管累积的最大信号电子数(电荷容量)除以传感器读取噪点的所有成分的总和(本底噪点)确定。),包括在特定积分时间内产生的时间噪点源。计算中包括了所有暗噪点源(例如暗电流噪点,像素读取噪点以及信号路径产生的时间噪点(但不包括光子散粒噪点))的影响。本底噪点限制了图像暗区中的图像质量,并且由于暗电流散粒噪点而随着曝光时间增加。因此,实际上,动态范围是最大可检测信号与最小同时可检测信号(本底噪点)之比。动态范围通常以灰度,分贝或位来报告,信号电子与噪点之比越高,产生的动态范围值就越大(分贝或比特越多)。注意,动态范围由传感器的信噪特性控制,而位深度是传感器中使用的模数转换器的函数。因此,12位数字转换对应于略高于4,000灰度级或72分贝,而10位数字化可以解析1,000灰度级,这对于60分贝的动态范围来说是合适的位深度。随着传感器动态范围的增加,同时记录图像中最暗和最亮强度(场景内动态范围)的能力也得到了提高,检测器的定量测量能力也得到了提高。该interscene动态范围 代表当针对不同的视场调整检测器增益,积分时间,镜头光圈和其他变量时可以容纳的强度光谱。

CMOS图像传感器最通用的功能之一就是能够以很高的帧速率捕获图像。这样可以通过软件控制的界面记录延时序列和实时视频。每秒30到60帧之间的速率很常见,而一些高速成像仪可以达到超过1000的速率。为了生产可拍摄的相机系统,还需要其他支持电路,包括协处理器和外部随机存取存储器这些功能的优势。

结论

CMOS图像传感器是在大批量晶圆工厂中采用公认的标准硅工艺制成的,该工厂还生产相关的芯片,例如微处理器,存储电路,微控制器和数字信号处理器。巨大的优势在于,数字逻辑电路,时钟驱动器,计数器和模数转换器可与光电二极管阵列放置在相同的硅基板上,并同时放置。这使CMOS传感器能够以与其他集成电路类似的方式参与缩小到最小线宽的工艺缩小过程,从而减少重新设计的时间。即使如此,为了保证具有高性能的低噪点设备,通常必须修改标准CMOS制造工艺以专门容纳图像传感器。例如,当将标准的CMOS技术用于逻辑芯片中的晶体管结时,将其应用于成像设备时可能会产生高暗电流和低蓝光响应。优化图像传感器的工艺通常需要权衡取舍,这使制造方案对于普通的CMOS器件不可靠。

在过去的几年中,像素大小一直在缩小,从1990年代中期主导设备的10-20微米巨型像素到目前席卷市场的6-8微米传感器。对微型电子成像设备(例如监视和电话摄像机)的更大需求促使设计人员进一步降低像素尺寸。具有4-5微米像素的图像传感器已用于具有较小阵列的设备中,但数百万像素的芯片将需要3至4微米范围的像素大小。为了达到这些尺寸,必须在0.25微米或更窄的生产线上生产CMOS图像传感器。通过采用更窄的线宽,可以将更多的晶体管封装到每个像素元素中,同时保持可接受的填充因子,前提是缩放比例因子接近1。用0.13到0。

尽管许多CMOS制造工厂缺少添加滤色器和微透镜阵列的工艺步骤,但是随着市场需求的增长,这些步骤正越来越多地用于图像传感器的生产。另外,对于成像设备至关重要的光学包装技术需要洁净室和平板玻璃处理设备,这在制造标准逻辑和处理器集成电路的工厂中通常不存在。因此,用于图像传感器制造的增加成本可能是巨大的。

在过去的几年中,CMOS图像传感器的应用列表急剧增加。自1990年代后期以来,CMOS传感器已在越来越多的应用程序(例如传真机,扫描仪,安全摄像机,玩具,游戏,PC摄像机和低端消费类摄像机)中销售的成像设备中占了越来越大的比例。未来几年,多功能传感器也可能会开始出现在手机,条形码阅读器,光电鼠标,汽车甚至家用电器中。由于CMOS传感器能够以高帧频捕获连续图像,因此它们越来越多地用于工业检查,武器系统,流体动力学和医学诊断。尽管在大多数高端应用中不能期望取代CCD